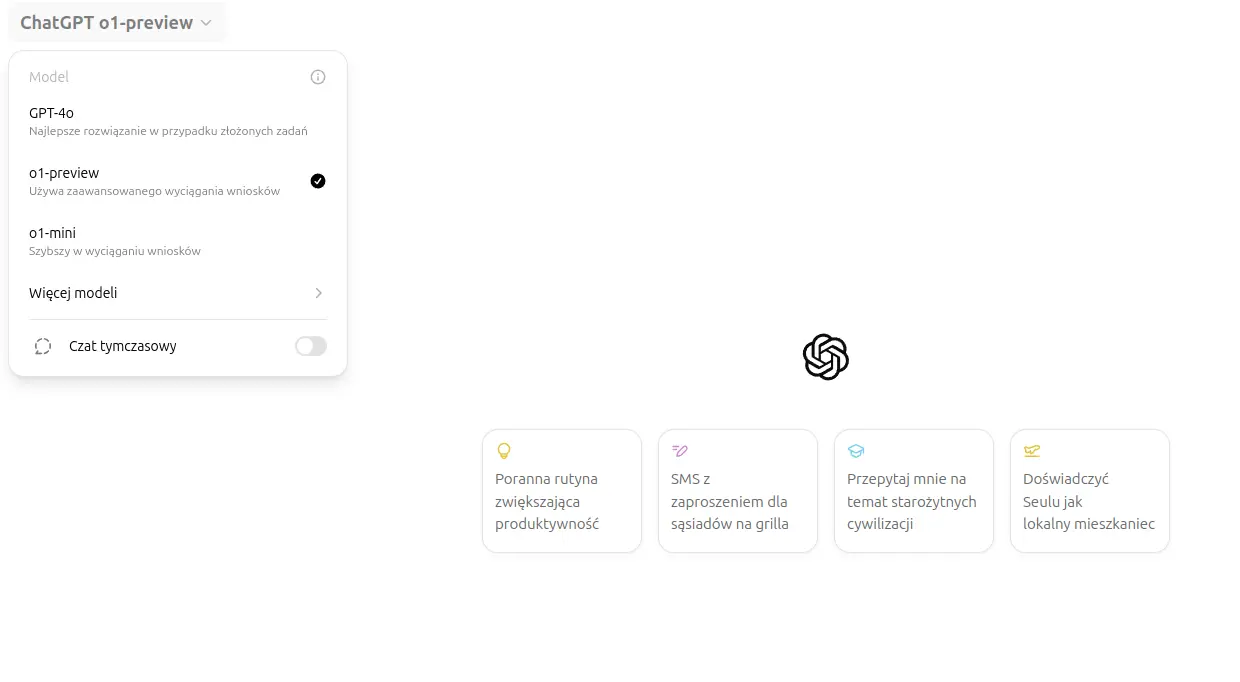

Wprowadzenie nowych modeli językowych do ChatGPT, takich jak o1-preview i o1-mini, może się wiązać z odmiennymi strategiami tworzenia promptów. Modele te różnią się od swoich poprzedników i często działają najlepiej w określonych warunkach. W tym artykule przedstawimy najlepsze praktyki w zakresie inżynierii promptów dla tych modeli, aby uzyskać z nich jak największą wydajność.

Proste i bezpośrednie zapytania

W przeciwieństwie do starszych modeli GPT, które często wymagały bardziej złożonych promptów lub technik, takich jak few-shot prompting, modele z serii o1 działają najlepiej, gdy dostają krótkie i jasne instrukcje. Długie, rozbudowane polecenia mogą nie tylko obniżyć wydajność modelu, ale także prowadzić do nieoczekiwanych wyników. Dlatego podstawowa zasada brzmi: utrzymuj prompty zwięzłe i konkretne.

Na przykład, zamiast stosować skomplikowane polecenia:

- Nie zalecane: „Wyjaśnij krok po kroku, jak działają silniki spalinowe, odnosząc się do fizyki, chemii i historii wynalazków.”

Lepiej użyć prostego zapytania:

- Zalecane: „Jak działają silniki spalinowe?”

Unikanie promptów typu „chain-of-thought”

Starsze modele GPT, takie jak GPT-3, często korzystały z promptów nakazujących modelowi „myśleć krok po kroku” (tzw. chain-of-thought prompting). W przypadku modeli o1-preview i o1-mini taka technika jest zbędna. Modele te wykonują rozumowanie wewnętrznie, co oznacza, że sztuczne wymuszanie myślenia krok po kroku może wręcz zmniejszyć ich wydajność.

Dlatego należy unikać instrukcji w stylu:

- Nie zalecane: „Pomyśl krok po kroku i rozważ wszystkie możliwe opcje, zanim udzielisz odpowiedzi.”

Zamiast tego lepiej jest sformułować proste pytanie:

- Zalecane: „Jakie są opcje rozwiązania tego problemu?”

Używaj ograniczników dla jasności

W sytuacjach, gdzie prompt składa się z wielu części, takich jak pytania złożone lub zapytania wymagające analizy dokumentów, warto stosować ograniczniki. Mogą to być:

- Potrójne cudzysłowy (

""") - Tagi XML

- Sekcje tytułowe

Stosowanie tych metod pozwala modelowi wyraźniej rozróżniać różne fragmenty promptu, co poprawia jego interpretację i odpowiedzi. Przykład:

- Zalecane:

Podziel poniższy tekst na sekcje:

"""

Sekcja 1: Wstęp

Sekcja 2: Główna część

Sekcja 3: Podsumowanie

"""Ograniczanie dodatkowego kontekstu

Dostarczanie nadmiaru kontekstu, takich jak załączanie zbyt obszernych opisów, może być nieefektywne w przypadku modeli o1-preview i o1-mini. Modele te radzą sobie bardzo dobrze z syntetyzowaniem krótszych fragmentów informacji, co sprawia, że zbyt długie wprowadzenia mogą wprowadzać zamieszanie. Dlatego najlepiej jest skupić się na dostarczeniu tylko najistotniejszych informacji.

Na przykład, zamiast podawać obszerną dokumentację:

- Nie zalecane: „Oto cała dokumentacja projektu, przeanalizuj ją i podsumuj wnioski.”

Zastosuj ograniczenie długości:

- Zalecane: „Podsumuj kluczowe wnioski z poniższego tekstu (maksymalnie 3 akapity).”

Podsumowanie

Modele z serii o1, w tym o1-preview i o1-mini, wprowadzają nową jakość w przetwarzaniu języka naturalnego, ale wymagają stosowania nowych technik tworzenia promptów. Proste, zwięzłe zapytania, unikanie rozbudowanych technik takich jak chain-of-thought, oraz stosowanie ograniczników to kluczowe zasady, które pozwolą osiągnąć najlepsze wyniki. Unikając nadmiaru kontekstu, a także nadmiernego rozbudowywania promptów, można znacząco poprawić efektywność pracy z tymi modelami.

Dzięki tym wskazówkom, będziesz w stanie lepiej formułować zapytania do modeli o1 i uzyskiwać optymalne odpowiedzi.