OpenAI kontynuuje swoje swoją rewolucję AI, wprowadzając nowy model GPT-4o mini. Jest to najbardziej ekonomiczny mały model w ofercie, który znacznie obniża koszty korzystania z zaawansowanych funkcji AI. Dzięki cenie 15 centów za milion tokenów wejściowych i 60 centów za milion tokenów wyjściowych, nowy model jest o wiele tańszy niż jego poprzednicy, co otwiera nowe możliwości dla twórców aplikacji.

Wydajność i zastosowania GPT-4o mini

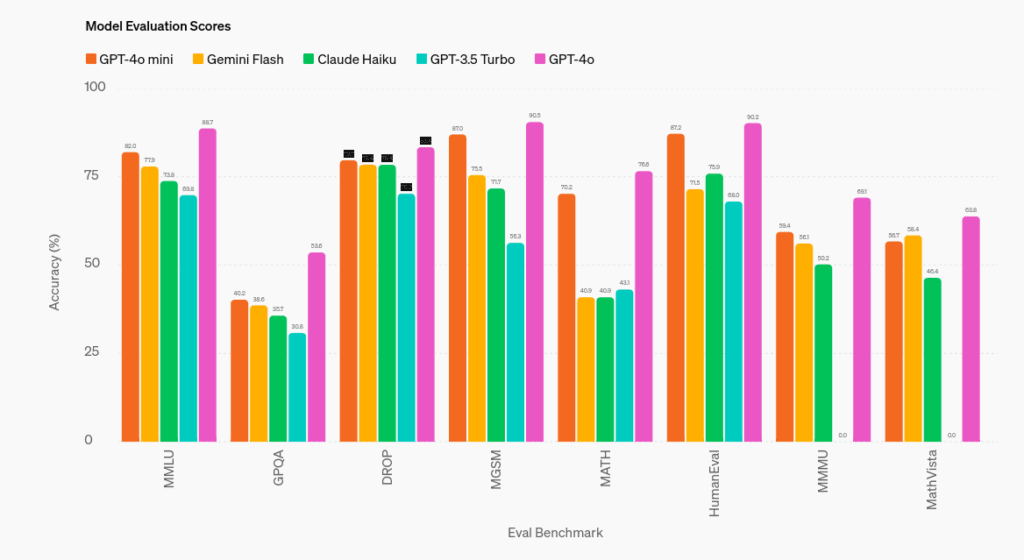

GPT-4o mini osiąga imponujące wyniki w różnych zadaniach. Model zdobywa 82% na benchmarku MMLU, co przewyższa inne małe modele, takie jak Gemini Flash i Claude Haiku. W zadaniach matematycznych i programistycznych model również wykazuje się wysoką sprawnością, osiągając 87% na MGSM i 87,2% na HumanEval.

Te wyniki sprawiają, że model jest idealnym narzędziem do tworzenia aplikacji, które wymagają zarówno tekstowych, jak i wizualnych umiejętności rozumowania.

GPT-4o mini jest wszechstronny, umożliwiając szeroki zakres zastosowań dzięki niskim kosztom i opóźnieniom. Może być wykorzystywany do zadań takich jak łączenie wielu wywołań API, przetwarzanie dużych wolumenów kontekstu, czy szybkie, interaktywne odpowiedzi tekstowe w czasie rzeczywistym, co jest szczególnie przydatne na przykład w rozwiązaniach dotyczących obsługi klienta.

Bezpieczeństwo

OpenAI kładzie duży nacisk na bezpieczeństwo swoich modeli. Nowy model został zaprojektowany z wbudowanymi środkami bezpieczeństwa, które obejmują filtrowanie treści podczas treningu oraz wykorzystanie technik takich jak wzmocnione uczenie z ludzką informacją zwrotną (RLHF) w celu poprawy dokładności i niezawodności odpowiedzi. Model jest również odporny na próby obejścia zabezpieczeń, co czyni go bardziej niezawodnym i bezpiecznym do użycia na dużą skalę.

Model jest już dostępny w API Assistants, Chat Completions oraz Batch, z planami na wprowadzenie funkcji dostrajania w najbliższych dniach. Użytkownicy ChatGPT Free, Plus oraz Team mają już dostęp do GPT-4o mini, a użytkownicy Enterprise będą mieli dostęp od przyszłego tygodnia.

Nowy model to spora rewolucja dla twórców aplikacji, umożliwiając tworzenie i skalowanie potężnych aplikacji AI w sposób bardziej efektywny i przystępny cenowo. Dzięki dalszym pracom nad obniżaniem kosztów i poprawą zdolności modeli, przyszłość sztucznej inteligencji staje się coraz bardziej dostępna, niezawodna i zintegrowana z naszymi codziennymi doświadczeniami cyfrowymi.